In un nostro precedente articolo abbiamo esaminato i Large Language Models (LLMs) e presentato le loro potenzialità in una vasta gamma di applicazioni. Una delle aree più affascinanti e rilevanti in cui questi modelli stanno facendo sentire il loro impatto è quella della sicurezza informatica e del cyber-crime. Come questi strumenti innovativi vengono utilizzati in questo settore? Possono davvero rivoluzionare i processi di lavoro e migliorare la gestione dei flussi critici?

In questo articolo, esploreremo in dettaglio l’adozione crescente dei LLMs nella cyber-security. Scopri come VirusTotal sta sfruttando questi strumenti per l’analisi del codice e come le piattaforme Any.Run e Burp Suite hanno integrato ChatGPT, mettendo a portata di click dei professionisti un potente assistente.

In un contesto in cui la carenza di esperti è una sfida sempre presente, questi strumenti promettono di rendere il lavoro più efficiente e di alleggerire i professionisti da attività time-consuming, fungendo da validi supporti nella gestione della crescente complessità delle minacce informatiche. Da qualche giorno è disponibile in anteprima Microsoft Security Copilot, che promette di rivoluzionare il modo di lavorare dei professionisti del settore.

D’altra parte, è importante riconoscere che, se da un lato i LLMs possono contribuire a colmare il divario tra la domanda di professionisti qualificati e l’offerta, dall’altro possono rappresentare una minaccia: quando finiscono in mano a criminali informatici, questi modelli possono drasticamente abbassare la barriera tecnica per orchestrare attacchi informatici di vasta portata.

L’uscita di ChatGPT ha certamente segnato un epoca: l’ultimo anno è stato segnato da una corsa allo sviluppo e all’utilizzo di motori linguistici avanzati in ogni tipo di applicazione. La rivoluzione è duplice:

In questa scia, sicuramente anche il settore della sicurezza informatica sta evolvendo grazie ai modelli LLM: l’automatizzazione di azioni ripetitive è diventata una priorità, grazie alla quale è possibile migliorare in modo significativo il modus operandi di team di sicurezza. Inoltre, la presenza di assistenti digitali permette ai professionisti di velocizzare i processi di decision making e di reportistica in risposta a incidenti. I modelli linguistici che conosciamo possono essere addestrati e migliorati con l’obiettivo di migliorare per questi task specifici.

Microsoft Security Copilot, disponibile in Early Access da qualche giorno (leggi qui) va in questa direzione: un assistente LLM per i team di sicurezza che promette di essere in grado di far risparmiare fino al 40% del tempo sulle attività principali delle operazioni di sicurezza e di poter accrescere le competenze di un team, indipendentemente dalla sua esperienza.

Dal punto di vista tecnico, le operazioni automatizzabili e supportabili da LLM:

Tra i grandi player del settore della sicurezza che utilizzano motori LLM troviamo Any.Run, un seller di sandbox per analisi dinamica. Innanzitutto, Any.Run spiega dei casi d’uso interessanti per ChatGPT et simili, con approfondimenti nel blog di Any.Run:

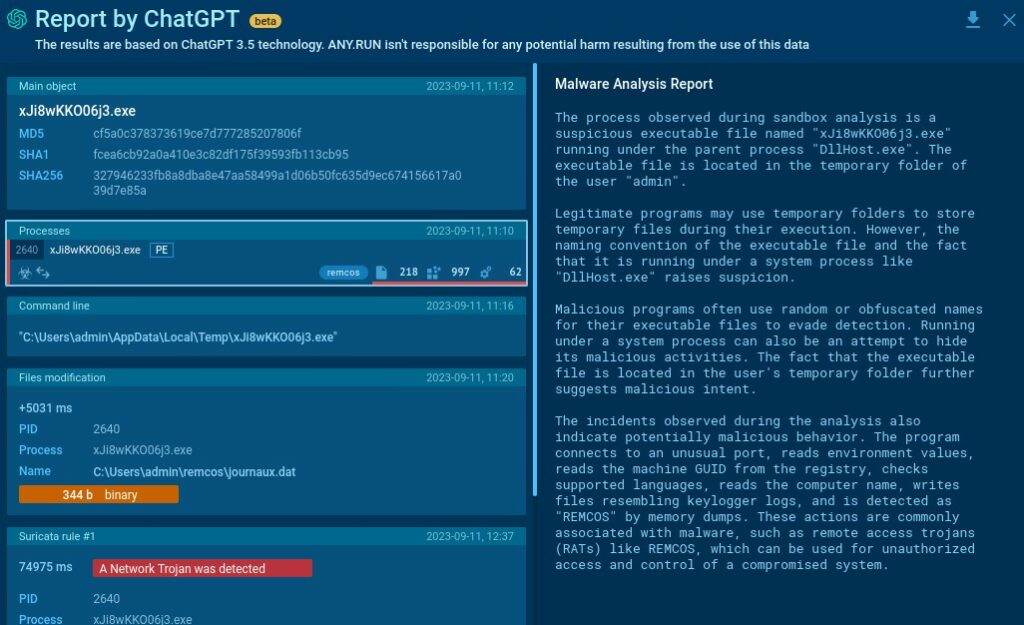

Tuttavia, ancora più sorprendente è la scelta di Any.Run di integrare ChatGPT nella piattaforma di analisi, aprendo a possibilità di automatizzazioni molto interessanti:

Ecco un esempio di generazione automatica di una descrizione relativa a un processo sospetto individuato.

La scelta di Any.Run sembra quella di mettere a disposizione all’analista il supporto di un LLM a portata di click direttamante sulla piattaforma.

Nella stessa direzione, BurpGPT è una estensione di Burp Suite Professional utilizzata per migliorare la precisione e l’efficienza dei test di sicurezza delle applicazioni sfruttando LLM. Questa estensione sfrutta l’IA per identificare vulnerabilità di sicurezza che potrebbero sfuggire agli scanner tradizionali. Funziona inviando il traffico web a un modello OpenAI personalizzabile, come ad esempio ChatGPT, per effettuare analisi sofisticate all’interno del processo di scansione passiva. Inoltre, questa estensione è in grado di generare report di sicurezza automatizzati che riassumono potenziali vulnerabilità in base alle richieste dell’utente e ai dati in tempo reale provenienti dalle richieste effettuate tramite Burp. Sfruttando LLMs, BurpGPT semplifica il processo di valutazione della sicurezza, fornendo ai professionisti della sicurezza una visione dettagliata delle applicazioni o dei punti di accesso esaminati.

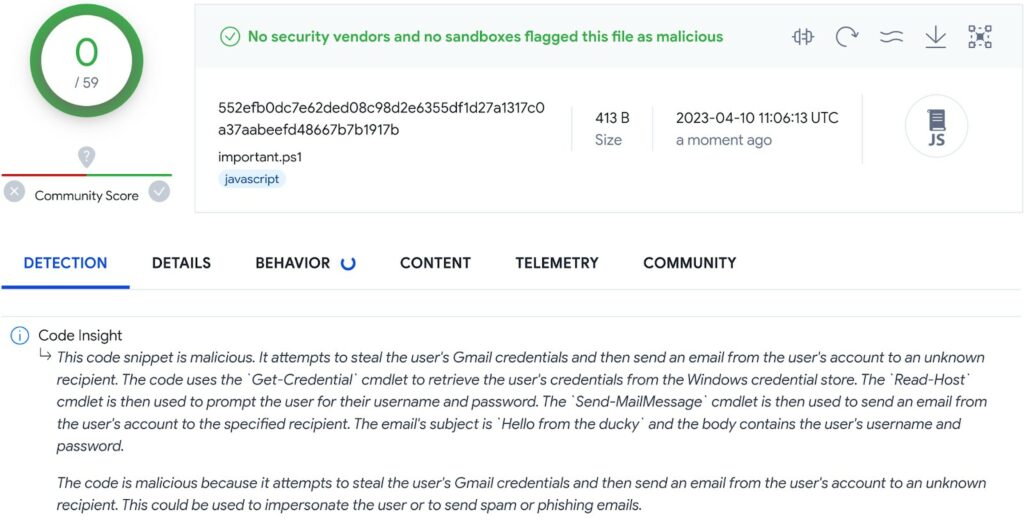

Un altro colosso del settore come VirusTotal ha annunciato nell’Aprile di quest’anno Code Insight, una funzionalità all’avanguardia che sfrutta l’intelligenza artificiale per l’analisi del codice. Basato su Google Cloud Security AI Workbench, Code Insight produce con riepiloghi di snippet di codice sottomessi attraverso il modello LLM Sec-PaLM, ottimizzato per i casi d’uso della sicurezza. Questa funzionalità potenzia gli esperti e gli analisti della sicurezza fornendo loro informazioni più approfondite sullo scopo e sul funzionamento del codice analizzato, migliorando significativamente la loro capacità di rilevare e mitigare potenziali minacce. Un esempio è riportato di seguito.

VirusTotal ha compiuto un ulteriore passo significativo nell’applicazione di LLM nel mondo cyber: a Luglio del 2023 è stata presentata l’iniziativa Crowdsourced AI, l’apertura della piattaforma all’integrazione di modelli di IA da parte della comunità. La prima a rispondere a tale iniziativa è stata Hispasec, un’azienda dedicata allo sviluppo di motori anti-malware. La loro iniziativa è incentrata sull’analisi delle macro presenti in file Microsof Office (Word, Excel, etc.). Nel link seguente possono essere trovati approfondimenti a riguardo.

E se anche gli autori di malware avessero a disposizione un assistente digitale per supportarli nelle loro azioni? I LLMs hanno indubbiamente incrementato le compotenze sia di script kiddies che di gruppi organizzati e di venditori di minacce as a service. In particolare, il seguente video, parte di un corso di SANS Offensive Operations, mostra come gli autori di minacce possono sfruttare LLMs per creare attacchi di phishing, notizie false e altre campagne dannose più convincenti.

Quanto descritto in precedenza come punti di forza dei LLMs possono essere sfruttati anche nel cyber-crime! Ecco un elenco di attività che i LLMs possono supportare:

Il nostro precedente articolo L’ombra oscura dell’IA al servizio del crimine informatico, arriva FraudGPT ha approfondito diverse versioni di LLMs, disponibili nel DarkWeb e Telegram, che non hanno filtri sui prompt e sulle richieste fatte al motore linguistico.

I Large Language Model stanno profondamente cambiando il modo di lavorare nella sicurezza, molte aziende stanno rispondendo a tali cambiamenti mettendo a disposizione agli operatori del settore strumenti sempre più potenti. Altre piattaforme seguiranno? I modelli linguistici hanno definitivamente cambiato il modo di approcciarsi alla sicurezza?