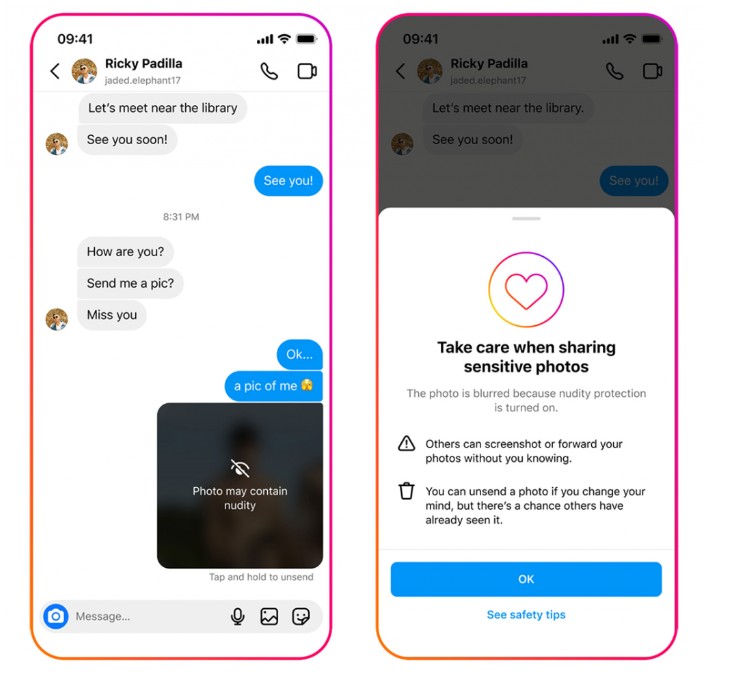

Meta, proprietaria del social network Instagram, ha recentemente annunciato una serie di nuove funzionalità volte a proteggere gli adolescenti da contenuti inappropriati. Tra questi c’è una funzione che sfoca automaticamente le foto contenenti parti del corpo nude, oltre ad avvertimenti per gli utenti che inviano tali immagini.

Le nuove misure di sicurezza saranno abilitate di default per gli utenti Instagram sotto i 18 anni. Agli utenti più grandi di età, a loro volta, verrà chiesto di abilitare autonomamente queste funzioni.

Meta sta inoltre sviluppando una tecnologia per identificare gli account coinvolti nell’estorsione di foto intime. Tali account avranno una capacità limitata di interagire con altri utenti, in particolare con gli adolescenti.

Secondo i rappresentanti di Meta, le misure mirano a proteggere gli adolescenti dal cyberflashing (battute sistematiche offensive che possono portare a tragedie) e dalla sextortion (ricatto tramite materiale intimo). L’azienda spera che le nuove funzionalità contribuiscano a proteggere i giovani utenti del social network da tali rischi.

Meta ha adottato alcune misure in passato per proteggere i minori, come rendere privati i loro account per impostazione predefinita. Tuttavia, l’azienda è stata ancora criticata per il fatto che tali misure non fossero sufficienti.

Adesso, probabilmente, anche il critico più esigente sarà soddisfatto, perché l’esperienza degli adolescenti che interagiscono sui social network è diventata molto più sicura.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Cybercrime

CybercrimeLe autorità tedesche hanno recentemente lanciato un avviso riguardante una sofisticata campagna di phishing che prende di mira gli utenti di Signal in Germania e nel resto d’Europa. L’attacco si concentra su profili specifici, tra…

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…