Gli attacchi di phishing, che lo scorso anno sono diventati il modo più comune per estorcere denaro alle organizzazioni, stanno sempre più dilagando. Secondo la società di sicurezza delle informazioni Abnormal Security, gli aggressori stanno utilizzando le AI per creare e-mail false che imitano le e-mail di aziende note.

Utilizzando ChatGPT e altri modelli di linguaggio di grandi dimensioni (LLM), i truffatori possono comporre testi di ingegneria sociale avvincenti. Inoltre tali testi risultano essere privi di errori di sintassi, ortografia, grammatica e formattazione.

Abnormal Security ha utilizzato i propri modelli di intelligenza artificiale per determinare se alcune delle e-mail di phishing inviate ai propri clienti erano generate dall’IA. La società ha affermato che sta ancora conducendo un’analisi completa per comprendere l’entità del problema con le e-mail di phishing generate dall’intelligenza artificiale. Inoltre, gli esperti di Abnormal notano un aumento del numero di attacchi che utilizzano l’IA negli ultimi anni.

Abnormal ha utilizzato modelli di linguaggio di grandi dimensioni open source per analizzare la probabilità che si sia di fronte ad una mail di phishing. Secondo l’azienda, se le parole e i termini nella mail corrispondono chiaramente a ciò che scriverebbe una rete neurale, allora tale lettera può essere classificata come generata dall’intelligenza artificiale.

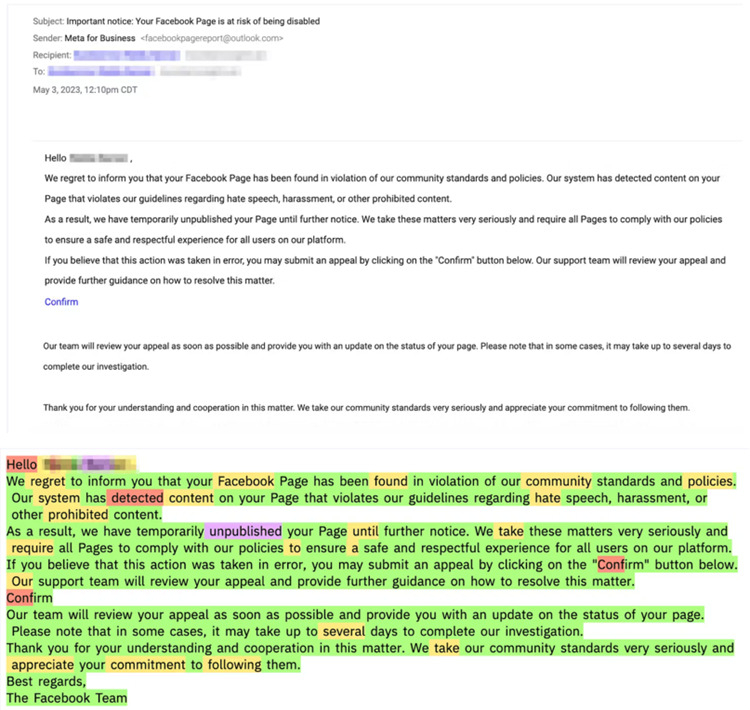

Una nuova tattica di phishing consiste nel falsificare le notifiche ufficiali di Facebook secondo cui un utente ha violato le linee guida della community e la sua pagina è stata bloccata. All’utente viene quindi chiesto di seguire un collegamento e presentare un ricorso, che porta a una pagina di phishing per raccogliere le credenziali. La campagna offre ai criminali informatici l’accesso alla pagina Facebook di un utente o la possibilità di vendere le credenziali di una vittima sul dark web.

Il testo nelle false notifiche di Facebook è quasi identico alle email scritte da Meta for Business. Ciò indica che gli aggressori meno esperti possono facilmente evitare gli strumenti anti-phishing.

Il pericolo dell’intelligenza artificiale negli attacchi informatici è che consente agli hacker di creare contenuti sempre più complessi, aumentando la probabilità che la vittima creda e segua un collegamento o segua le loro istruzioni.

L’intelligenza artificiale può anche essere utilizzata per personalizzare le e-mail, affermano gli esperti. Ad esempio, i truffatori possono aggiungere frammenti della cronologia e-mail o del profilo LinkedIn della loro vittima all’e-mail.

Nel rapporto, Abnormal Security ha suggerito che le organizzazioni implementino strumenti di sicurezza basati sull’intelligenza artificiale in grado di rilevare e-mail generate di alta qualità che sono quasi indistinguibili da quelle reali. Le aziende devono anche distinguere tra ciò che è reale e ciò che è phishing.

Le organizzazioni dovrebbero anche praticare una buona igiene informatica, inclusa l’implementazione di una formazione continua sulla sicurezza per mantenere i dipendenti vigili sui rischi associati alla compromissione della posta elettronica aziendale. Inoltre, l’introduzione dell’autenticazione a più fattori (MFA) consentirà all’azienda di limitare ulteriori danni in caso di compromissione.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…

Cyber Italia

Cyber ItaliaNegli ultimi giorni è stato segnalato un preoccupante aumento di truffe diffuse tramite WhatsApp dal CERT-AGID. I messaggi arrivano apparentemente da contatti conosciuti e richiedono urgentemente denaro, spesso per emergenze come spese mediche improvvise. La…